“Esta idea de que con Felipe Calderón [presidente mexicano de 2006 a 2012] estalló la violencia asociada al narcotráfico… yo quería que los datos vinculados me lo explicaran, y fue cuando encontré la explosión de células delictivas y cómo están reconocidas por las mismas autoridades que generaron esa violencia”,

dice Tania Montalvo, reportera que desde 2014 investiga el comportamiento de cuatro décadas de narcotráfico mexicano a través de bases de datos, trabajo conocido como NarcoData.

“Más allá de las ideas que tenemos, ¿qué argumentos realmente sostenibles tenemos para saber si esa idea es verdad o no? Para eso sirven realmente los datos en el periodismo”.

Montalvo, de 31 años, se ha hecho de una visión clara del periodismo de datos al cuantificar el poder y sus abusos en investigaciones sobre violaciones de la ley en detrimento del ambiente en la Ciudad de México, corrupción e incumplimiento de promesas al verificar el pago de nóminas a maestros (algunos de los cuales cobraban desde ultratumba) y, por supuesto, NarcoData, entre otras más.

¿Cómo han guiado los datos sus investigaciones periodísticas?

NarcoData

Celda por celda, columna por columna, Montalvo construyó una imagen de datos para lo que llama “una sombra sin rostro”, la del crimen organizado. Entre otras conclusiones, cuantificó la explosión de la violencia: al finalizar el sexenio anterior a Calderón eran tres bandas criminales armadas que se tenían monitoreadas, tras seis años de una estrategia militarizada en su contra, se multiplicaron hasta sumar 52.

¿Cómo guiaron los datos a Montalvo y al equipo de Animal Político y Poderopedia de un documento único que obtuvieron en octubre de 2014, donde meramente se enlistaban los grupos delictivos activos ese año, territorio y cártel al que obedecían, hacia el análisis detallado de prácticamente toda la historia del narcotráfico en México?

“Lo que yo quería era tener toda la información en un mismo lugar, porque la información sobre el narco es tanta que no sabíamos dónde estaba la nota”.

La primera base que construyó fue sencillamente esa: qué organizaciones criminales había, su presencia en el territorio mexicano y su lealtad a cárteles determinados.

“Tuve que ir hacia atrás para mostrar cómo esas organizaciones antes no existían, porque los datos me fueron hablando y me hicieron preguntar ¿por qué ahora son 9 cárteles, cómo llegamos a ellos, por qué de pronto son más violentos, por qué unos son más grandes que otros? y todo eso lo pude hacer gracias a la primera base de datos”.

A partir de esa base “madre”, a golpe de teclazo en Excel, Montalvo construyó una nueva, que califica como una investigación de fuentes híbridas.

“No es un trabajo cuantitativo 100 por ciento. A la información en papel de la Procuraduría General de la República (PGR) agregué información de análisis que encontré en documentos académicos sobre estudio de crimen organizado, más información de entrevistas y comunicados y boletines de la misma PGR a medios.”

Después interrogó a su nueva base.

“¿Qué era lo que me estaba mostrando? Hay que tener la mente muy abierta a hacer cualquier pregunta a los datos, hasta la más complicada, no obviar cosas, y tampoco creer que no vas a encontrar tus respuestas en la base, porque realmente los datos hablan, y hablan muchísimo”.

La respuesta entonces fue obvia. Los datos mostraban la pulverización de los grupos criminales en mayor número aparejada al incremento de la violencia con los años.

“Era la evolución de las bandas del crimen organizado, me estaba mostrando quiénes son los dominantes, que hubo una separación entre ellos. Eso me llamó a responderme con los mismo datos: ‘hay conflictos muy específicos entre los grandes cárteles’.”

“Es necesario entender qué es lo que tienes: si tienes años, cuáles son tus campos… Con base en ello ves hacia dónde te pueden llevar los datos. Siempre respeta a tu base en el sentido de tenerla limpia, conocerla, para que te hable. Si no está limpia, cuando te ‘escupa’ una respuesta, no la vas a ver”.

NarcoData ha alcanzado siete entregas, pero las bases construidas por Tania aún no agotan su potencial. Este trabajo, no obstante, no era el primero en el que Montalvo construyera y analizara una base de datos.

Censo de la Reforma Educativa

CC By CEDIM News

En un proceso de supuesta renovación de estructuras mexicanas como la energética, la fiscal y la educativa, una de las promesas de avance en esta última fue la depuración de la nómina de profesores que reciben pago del erario público.

No más fallecidos que cobran sueldo por enseñar, maestros que renunciaron y cuyos pagos no obstante siguen siendo religiosamente cobrados o maestros que jamás dieron una sola clase frente a grupo. La investigación que Tania Montalvo publicó en 2015, sobre la nómina nacional de maestros, descubrió que la promesa era, al menos hasta entonces, falsa.

Lo probó a través de la construcción y cruce del recién hecho censo magisterial nacional contra la nómina pagada por la Secretaría de Hacienda y Crédito Público (SHCP).

“La idea surgió de una base que nos entregó Gobierno de Oaxaca después de una solicitud de transparencia, con 40 mil celdas: cada maestro, cada escuela. Pudimos ver maestros hasta con 30 plazas, solamente en Oaxaca”.

Esa base se escaneó desde las infames fotocopias en papel que le fueron entregadas, desde donde escrapeó con algunas herramientas como Cometdocs, Tábula e Import.io.

Para ampliarla a nivel nacional, Tania recurrió al Instituto Mexicano para la Competitividad, con quienes obtuvo ayuda para rastrear los datos nacionales relacionados con la nómina magisterial a través de la plataforma de datos abiertos del gobierno federal, por entonces una novedad.

“Creo que de alguna forma ese fue mi primer acercamiento con los Datos Abiertos de gobierno, yo estaba escéptica, pero base con solicitud por cada estado, hubiésemos tardado muchísimo. Pudimos hacerlo a nivel nacional, pudimos comparar cómo la nómina antes y después de la reforma educativa no había cambiado, sino en un mal sentido, les estaban pagando más a los maestros pese a que se suponía que ya les habían depurado, y lo pudimos ver trimestre a trimestre”.

La nómina, pagada por SHCP fue contrastada contra la base de datos de la Secretaría de Educación Pública (SEP), que recién había efectuado un censo donde se enlistaban qué maestros que daban clase frente a grupo, quiénes sólo realizaban labores sindicales y dejaba fuera “aviadores” y otros defraudadores.

“SHCP tiene que preguntar a SEP si todos esos maestros están frente a grupo y la SEP tuvo que haber verificado que estaban frente a grupo o si no murieron, porque había muchos muertos que seguían cobrando sueldos”.

Este año, la SEP reconoce por primera vez que dejó de pagar 5 mil plazas porque no estaban frente al grupo. “Eso debió haber ocurrido antes”, acota Montalvo.

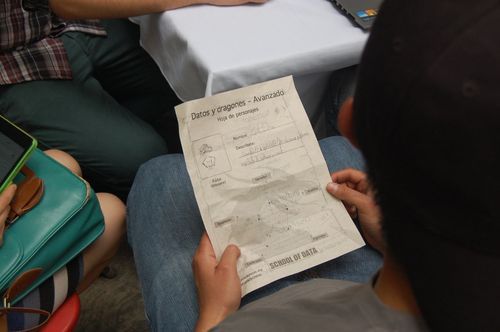

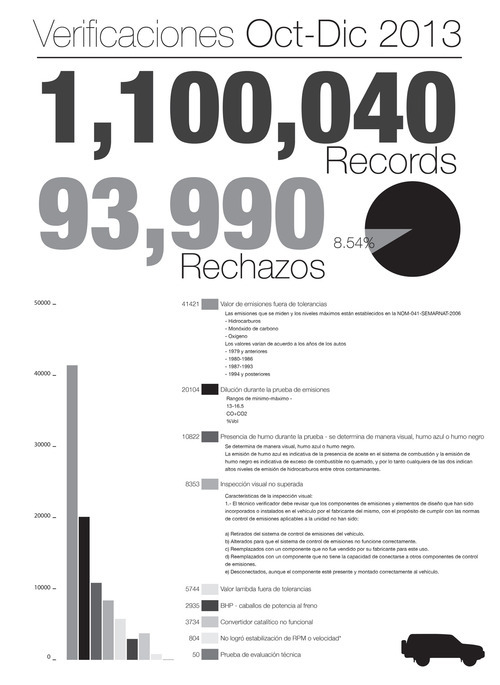

Gasolineras por colonia

En 2014 Montalvo desarrolló una investigación sobre las gasolineras que en la Ciudad de México violaban la ley al ser un excedente a lo permitido. En este trabajo el mayor reto fue la dispersión y falta de granularidad de algunos de los datos: Montalvo tenía por un lado información en porcentajes del excedente de gasolineras y por otra parte listados de todas las razones sociales de gasolineras en la Ciudad, pero no tenía las ubicaciones de las gasolineras que violaban la ley.

“Yo sabía que había más gasolineras y que se estaba violando el reglamento, Pemex tenía muchas bases de datos, pero tenía los nombres de gasolineras al azar, no me decía dónde estaban, pero nosotros obtuvimos otra base de datos por delegación.

“Pudimos entonces cruzar las bases de datos para saber en dónde estaban, y cruzamos con una base más, de la Procuraduría Federal del Consumidor (Profeco), para saber cuáles estaban sancionadas, y cuáles estaban violando la ley al abrir”.

Con la ayuda de las organizaciones Escuela de Datos y Social Tic, y en particular de Phi Requiem, Fellow de Escuela de Datos 2014, se logró la sistematización de dicha información.

“De alguna forma fue una base chiquita, pero el caso es que toda la denuncia ya estaba totalmente construida, yo tenía reporteado con los gasolineros que se estaba violando el reglamento, pero no tenía datos para hacerlo mucho más visible.

“Nos permitió construir este mapita donde ya fue lo único que necesitábamos para cerrar y así le mostramos solidez a nuestro argumento de que se estaba violando la ley”.

Datos para justificar opiniones

De cierto modo, la trayectoria de Tania Montalvo le permitió desarrollar una idea que inició en una clase de periodismo asistido por computadora (PAC) en alguna de sus clases de periodismo en el Tec de Monterrey.

“Lo que me llevé de esa materia es entender la importancia de usar datos, de que la información en cualquier nota periodística fuera precisa, más allá de una declaración”.

Justificar (o no) con datos las declaraciones de personajes públicos o de opiniones públicas ampliamente compartidas entre ciudadanos, ha sido el hilo conductor desde sus primeras investigaciones en CNN Expansión sobre la ubicación de víctimas de violencia hasta NarcoData.

“Todo tipo de periodismo debe tener datos, y los hay en todas partes. Entiendo el punto de que se le llame periodismo de datos pero al final es periodismo.

“Si es periodismo: narrativo, de explicación, de lo que sea, es súper importante saber usar los datos y hacerlo bien. En el periodismo de datos puedes usarlos en masa, una cosa mucho más grande, pero para llegar a eso tiene que empezar utilizando bien porcentajes, tasas, sabiendo cómo se hace una diferencia porcentual… cosas que son elementales para que sigas el camino de los datos y ya puedas utilizar una base mucho más grande”.

Otro punto que es necesario tener en mente, en opinión de Montalvo, es que la interdisciplinariedad no suple la obligación individual de aprender de otras disciplinas.

“El trabajo multidisciplinario es valiosísimo, pero al mismo tiempo es fundamental que entre todos comprendamos la labor del otro, aunque sea en la parte mínima. Yo no programo, pero creo que sí es necesario tener al menos ideas básicas porque un programador es valiosísismo y están dedicados. Difícilmente llegue a los niveles en que está nuestro programador, Gilberto León, pero yo debería saber que si quiero que Gilberto entienda mis ideas, yo debería entender las suyas a un nivel técnico”.

“Yosune, nuestra diseñadora, que sí sabe de programación, tuvo que aprender muchísimo de mi labor periodística, en términos de mi mirada como periodista para poder visualizarla y yo al mismo tiempo tuve que aprender de ella para poder comunicar lo que tenía. En ese sentido es muy importante conocer un poco de lo que hace que el otro”.